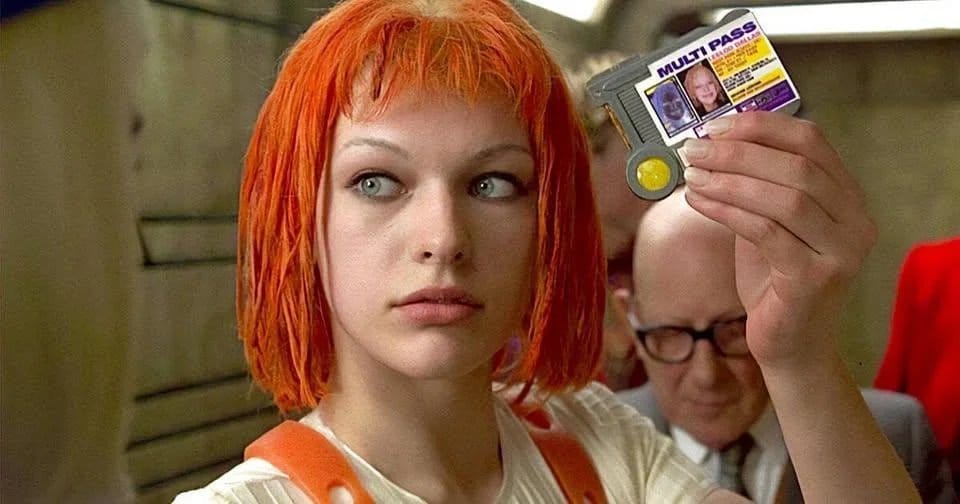

你大概已經在 X 或 Instagram 上看到了: Milla Jovovich,在 GitHub 上開源了一套 AI 記憶系統。不是掛名,是她的 GitHub 帳號(milla-jovovich/mempalace),MIT 授權,任何人都可以用。

2026 年 4 月 5 日上線,48 小時內衝到 7,000 顆星。寫這篇文章的時候已經超過 15,000 顆。Ben Sigman 在 X 上宣佈的當天就破了 150 萬次曝光。

先不管名人效應,這個專案到底在做什麼?宣稱的數字可不可信?對實際用 AI 工作的人來說有沒有意義?

Milla Jovovich 為什麼會去寫程式

故事的起點其實蠻好理解的。Jovovich 從 2025 年下半年開始密集使用 ChatGPT 和 Claude,累積了幾千則對話:商業決策、創意發想、除錯紀錄。然後她發現一件讓人抓狂的事——每次開新對話,AI 什麼都不記得。

她試了 Mem0 和 Zep 這些現有的記憶工具,但這些工具的做法是讓 AI 決定哪些值得記,哪些丟掉。結果就是她最需要的推理脈絡,恰好是被丟掉的那些。

她找了 Ben Sigman(Bitcoin 借貸平台 Libre Labs 的 CEO)合作,花了好幾個月用 Claude Code 把這個專案寫出來。Jovovich 負責架構設計,Sigman 負責工程實作。

有人覺得這是行銷操作,也有人覺得一個好萊塢女星真的參與技術架構設計很難讓人信服。不過從 Instagram 的影片和 GitHub 的提交紀錄來看,她確實有參與。至於參與的深度,外人很難完全確認。

MemPalace 的核心概念:全存、再找

大部分 AI 記憶系統的做法是「讓 AI 挑重點存」。Mem0 會擷取「使用者偏好 Postgres」這種摘要,但你當初解釋為什麼選 Postgres 的那段對話就不見了。

MemPalace 反過來:全部存下來,然後靠結構讓你找得到。

它借用了古希臘的「記憶宮殿」(method of loci)概念。演說家會在腦中建一棟建築,把要記的東西放在不同房間,靠著走過建築的路徑來回憶。MemPalace 把這個隱喻變成資料結構:

Wing(翼):最上層的分類。一個專案、一個人、或一個主題就是一個 wing。

Hall(廳):記憶類型的走廊——事實、事件、建議、情感脈絡。每個 wing 都有相同的 hall 結構。

Room(房間):具體的主題。比方說一個專案的 wing 底下,可能有 auth、billing、deployment 這些 room。

Closet 和 Drawer(衣櫃和抽屜):實際存記憶的地方。Drawer 存原始對話全文,Closet 存壓縮後的版本。

當不同 wing 底下出現同名的 room,系統會建立「隧道」(tunnel),把跨領域的同一主題串起來。

技術上,底層用的是 ChromaDB 做向量搜尋、SQLite 做知識圖譜。全部跑在本地端,不需要任何 API key,不需要付費,資料不會離開你的電腦。安裝只需要 pip install mempalace。

AAAK 壓縮語言:有意思但有問題

MemPalace 自創了一種叫 AAAK 的壓縮格式。基本上是極度縮寫的英文,任何 LLM 不需要特殊解碼器就能讀。團隊宣稱達到 30 倍壓縮且「無損」。

但這個「無損」的說法有問題。獨立分析發現,AAAK 模式下 LongMemEval 的成績從 96.6% 掉到 84.2%,差了 12.4 個百分點。另外,token 計算用的是 len(text)//3 這種粗糙的估算,不是真正的 tokenizer。團隊後來也在 README 承認了這個錯誤。

壓縮在大量重複實體的場景下可能有用,但小規模使用時,壓縮後的 token 數甚至比原文還多。

基準測試:96.6% 到底代表什麼

這是最有爭議的部分。

MemPalace 宣稱在 LongMemEval 上拿到 96.6%(raw 模式,零 API 呼叫),加上 Haiku rerank 後達到 100%。對比之下,Mem0 和 Zep 大約在 85% 左右。

聽起來很厲害。但拆開來看:

96.6% 測的是什麼? 這個分數來自「raw verbatim mode」——把未壓縮的原始對話丟進 ChromaDB,用標準的最近鄰搜尋。宮殿結構(wing、room、hall)完全沒有參與這個測試。換句話說,這個分數測的是 ChromaDB 的預設嵌入模型效能,不是 MemPalace 本身。

100% 的問題更大。 X 上的 Community Note 直接指出:100% 的 LongMemEval 分數是針對 3 個失敗問題做了修正後加上 LLM reranking 得到的,保留測試集的分數是 98.4%。LoCoMo 測試用了 top_k=50,但每個對話最多只有 19-32 個 session——等於把所有 session 都撈出來,讓 Claude Sonnet 做閱讀理解,繞過了向量檢索。

基準測試只做了檢索,沒有生成答案。 LongMemEval runner 對每個問題只做 recall@5 的檢查(前 5 個結果有沒有包含正確的 session ID),沒有實際讀取內容、生成回答、讓 judge 評分。

Penfield Labs 的獨立分析寫得很直白:「1.5 百萬曝光和 5,400 顆星的差異,不是工程造成的。」

不過要說句公道話: 96.6% 的 raw score 在零 API 成本的條件下,確實是目前公開結果中最高的。而且團隊在自己的 BENCHMARKS.md 裡(超過 5,000 字)其實很誠實地揭露了方法論的限制。問題出在發布的行銷訊息把這些注意事項全拿掉了。

34% 檢索改善:真實但普通

團隊宣稱宮殿結構帶來 34% 的檢索改善(從全域搜尋的 60.9% → wing+room 過濾的 94.8%)。

獨立分析指出,這其實就是 metadata filtering——在任何向量資料庫裡都是標準操作。把搜尋範圍從「所有東西」縮小到「特定專案的特定主題」,當然會更準。不是什麼新技術,但對於從來沒用過 metadata filtering 的人來說,組織結構本身確實有價值。

MCP 整合:19 個工具

MemPalace 提供了 MCP server,包含 19 個工具,涵蓋五大類:宮殿讀取、搜尋、知識圖譜查詢、日記/情感記錄、系統管理。

設定方式很簡單:

claude mcp add mempalace -- python -m mempalace.mcp_server

之後 Claude 會自動呼叫 mempalace_search 來回答問題。也支援 Gemini CLI。本地端模型可以用 wake-up 指令載入大約 170 token 的關鍵上下文。

比較特別的是 PALACE_PROTOCOL 這段嵌在 status 工具輸出裡的 prompt,會指示 AI 在回答任何關於人的問題前先查 MemPalace。這是不錯的 prompt engineering 實作。

程式碼的現實面

lhl/agentic-memory 這個 GitHub repo 做了非常詳細的獨立程式碼分析,幾個發現值得注意:

整個系統只用一個 ChromaDB collection。22,000 個 drawer 的規模下還行,但 palace graph 的建立需要掃描所有 metadata(每次 1,000 筆),L1 載入也是 O(n) 複雜度。沒有寫入確認機制,MCP 的 add_drawer 直接插入,也沒有輸入消毒(有 prompt injection 的風險)。

知識圖譜是扁平的三元組查詢,不是多跳圖遍歷。Hall 在 metadata 裡存在但實際檢索時沒有被用到。AAAK 的 decode 只是字串切割,不能重建原始文字。

這些都不是致命問題——專案才上線三天、21 個 Python 檔案、2 個 runtime 依賴。但 README 裡有些功能描述和實際程式碼對不上。

那 Mem0 和 Zep 不香嗎?

Mem0 拿了 2,400 萬美元融資,月費 19 美元起。Zep 月費 25 美元起。兩者都用 LLM 來決定什麼值得記。

MemPalace 免費、本地端、全文存儲。哲學不同:Mem0 是「精選摘要」,MemPalace 是「全存再找」。

對隱私敏感的使用者,或不想為記憶功能每月付費(約新台幣 600-800 元)的人來說,MemPalace 是目前唯一認真做本地端全文記憶的開源選項。但它沒有企業支援、沒有成熟的生態系、程式碼還在非常早期的階段。

名人效應與開源社群的碰撞

MemPalace 最有意思的地方,可能不是技術本身。

Brian Roemmele(The Zero-Human Company 創辦人)在上線幾天內就把 MemPalace 部署給 79 名員工。社群在幾小時內就抓到 README 的問題——token 計算錯誤、AAAK 壓縮範例不對。團隊也很快回應了。

但同時,有人質疑 Jovovich 的實際參與程度,有人認為整個行銷手法(宣傳數字和 BENCHMARKS.md 裡的誠實揭露之間的落差)有刻意操作嫌感。

Hacker News 和 Reddit r/ContextEngineering 上的反應很兩極。有人說「這顯示好的想法比程式碼本身更有價值」,有人說「看一下 GitHub issue #29,benchmark 的方法論早就被拆穿了」。

一個台灣的 Threads 用戶評論說得不錯:「挺有趣的專案,但實測不知道怎樣。」這大概是目前最中肯的態度。

對實際工作者的意義

如果你每天密集使用 Claude 或 ChatGPT,累積了大量對話裡的決策脈絡和技術推理,MemPalace 解決的問題是真的:每次開新 session 什麼都不記得。

你要不要現在就用它?要看你的容忍度。程式碼還很早期,可能會遇到 bug,MCP 整合在某些環境下可能不太穩定。但零成本試用(只要有 Python 和 pip 就行),風險也不高。

比較務實的方式是先在一個小專案上試跑 mempalace mine,看看結構化的搜尋是不是真的比你目前的做法好。不要期待 96.6% 的 benchmark 分數就代表你的每個問題都能被完美回答——那不是同一件事。

FAQ

MemPalace 和 Claude 內建的記憶功能有什麼不同?

Claude 的內建記憶會自動擷取重點並在對話之間保留,但使用者無法控制它記什麼、丟什麼。MemPalace 存下完整的原始對話,讓你透過結構化搜尋找回任何細節。兩者可以並用——Claude 記憶處理日常偏好,MemPalace 保留深度技術脈絡。

MemPalace 真的不需要任何 API 費用嗎?

raw 模式下完全不需要。安裝依賴只有 ChromaDB 和 PyYAML,向量嵌入用 ChromaDB 預設的本地模型。如果要用 hybrid 模式的 Haiku rerank,每次查詢大約 0.001 美元(約新台幣 0.03 元),但這不是必要的。

宮殿結構真的能改善搜尋品質嗎?

可以,但原理其實就是向量資料庫的 metadata filtering。把搜尋範圍從「所有資料」縮小到「特定 wing + room」,自然會更精準。MemPalace 的貢獻是提供了自動分類的機制,而不是 metadata filtering 這個技術本身。

AAAK 壓縮安全嗎?會不會丟失重要資訊?

AAAK 模式下 LongMemEval 分數從 96.6% 掉到 84.2%,所以嚴格來說不是無損的。原始對話永遠保存在 drawer 裡,AAAK 只是用來快速載入上下文。如果精確度很重要,建議使用 raw 模式搜尋。