OpenClaw 在 2026 年 3 月已累積超過 285,000 顆 GitHub Stars,成為史上最受歡迎的開源專案之一。 但這個由 Peter Steinberger 打造的 AI 代理框架本身只是一個「執行殼」——真正決定你的 OpenClaw 代理能否穩定執行任務、控制成本、避免安全風險的,是你選擇連接的 AI 模型。截至 2026 年 3 月,五款模型在 OpenClaw 社群中討論度最高:MiniMax M2.5、Moonshot AI Kimi K2.5、DeepSeek V3.2、Anthropic Claude Sonnet 4.6、OpenAI GPT-5.4。本文以實際 API 定價、基準測試分數、社群回饋與 OpenClaw 專屬場景為軸,提供一份可直接用於決策的比較框架。

為什麼模型選擇是 OpenClaw 成敗的關鍵

OpenClaw 的運作方式是將使用者透過 WhatsApp、Telegram、Discord 等通訊平台發送的指令,連同完整對話歷史打包送進 AI 模型。模型接收後必須完成三件事:理解上下文、規劃行動步驟、產出精確的工具呼叫(tool calls)讓 OpenClaw 執行。任何一環出錯,代理就會發錯郵件、改錯行事曆、或觸發錯誤的 shell 指令。

社群反覆強調的三大評估維度是:工具呼叫可靠性(模型能否穩定輸出正確的 JSON schema)、長上下文記憶力(對話進行到第 10 輪以上是否開始遺忘關鍵細節)、以及提示注入抵抗力(當代理瀏覽網頁或讀取郵件時,能否抵抗惡意指令注入)。Cisco AI 安全研究團隊在 2026 年初測試第三方 OpenClaw 技能時,發現存在未經使用者同意的資料外洩與提示注入攻擊,這凸顯了模型選擇在安全面的重要性。

五款模型核心規格比較

| 規格 | MiniMax M2.5 | Kimi K2.5 | DeepSeek V3.2 | Claude Sonnet 4.6 | GPT-5.4 |

|---|---|---|---|---|---|

| 發布日期 | 2026/02/12 | 2026/01/27 | 2025/12(持續更新至 2026/03) | 2026/02/17 | 2026/03/05 |

| 架構 | MoE(230B 總參數,10B 啟用) | MoE(1T 總參數,32B 啟用) | MoE(稀疏注意力 DSA) | Dense | Dense(推理模式可調) |

| SWE-Bench Verified | 80.2% | 76.8% | 與 GPT-5 同級 | 79.6% | ~80% |

| 上下文視窗 | 205K tokens | 262K tokens | 164K tokens | 1M tokens(Beta) | 1.05M tokens |

| 輸入定價 (USD/1M tokens) | $0.30 | $0.60 | $0.28 | $3.00 | $2.50 |

| 輸出定價 (USD/1M tokens) | $1.20(Lightning: $2.40) | $2.50–$3.00 | $0.40 | $15.00 | $15.00 |

| 多模態 | 文字 | 影像 + 影片 + 文字 | 文字 | 影像 + 文字 | 影像 + 文字 + 電腦操控 |

| 開源權重 | MIT(修改版) | MIT(修改版) | 開源 | 閉源 | 閉源 |

| 工具呼叫品質 | 優秀(SWE-Bench 表現強勁) | 優秀(Agent Swarm 模式) | 良好(偶有延遲問題) | 業界最佳 | 優秀(tool search 機制) |

| 每小時概估成本 | 約 USD 1(Lightning 版,100 TPS) | 約 USD 2–3 | 約 USD 0.50 | 約 USD 10–15 | 約 USD 12–18 |

定價換算:Claude Sonnet 4.6 的 $3/$15 定價,以每日中度使用量(約 500K input + 100K output tokens)估算,月費約 NTD 2,400;DeepSeek V3.2 同等用量月費約 NTD 300。

逐模型深度分析

MiniMax M2.5:性價比最高的程式碼專家

MiniMax M2.5 由北京 MiniMax 於 2026 年 2 月 12 日發布,是第一個在 SWE-Bench Verified 上逼近 Claude Opus 4.6 分數的開源模型。80.2% 的成績僅落後 Opus 4.6 約 0.6 個百分點,但 API 定價只有 Opus 的 1/10 到 1/20。

M2.5 的特色在於「建築師式思維」——在寫程式碼之前,模型會主動進行架構規劃、功能拆解與 UI 設計。這項行為在 RL 訓練過程中自然湧現,使得它在 OpenClaw 的多步驟程式碼生成任務中表現穩定。MiniMax 內部已有 80% 的新提交程式碼由 M2.5 產生,30% 的日常業務任務由模型自主完成。

Kilo Code 的實測顯示,M2.5 在三項 TypeScript 任務中得到 88.5/100 分,完成速度是 GLM-5 的兩倍(21 分鐘 vs 44 分鐘)。OpenHands 團隊的評測則確認 M2.5 是第一個在其綜合指標上超越 Claude Sonnet 的開源模型。

OpenClaw 適用場景:高頻程式碼生成與 bug 修復、預算敏感的 24/7 代理運行、需要自行部署模型的企業。

限制:偶爾忘記遵循特定輸出格式指令(如 OpenHands 團隊報告的標籤遺漏問題),上下文視窗 205K 相對較小。

Kimi K2.5:唯一具備 Agent Swarm 能力的開源模型

Moonshot AI 於 2026 年 1 月 27 日發布的 Kimi K2.5,最大賣點是 Agent Swarm 技術——能同時協調最多 100 個子代理並行執行任務。這不是簡單的任務分配,而是經過 Parallel-Agent Reinforcement Learning 訓練的動態編排系統:編排器(orchestrator)判斷何時需要新的子代理、分配什麼任務、何時委派工作。

在 BrowseComp(網頁搜尋能力測試)上,K2.5 的 Agent Swarm 模式從標準代理的 60.6% 跳升至 78.4%,在 WideSearch 上則從 72.7% 提升至 79.0%。Moonshot AI 的估值在這段期間從 25 億美元攀升至 43 億美元,並正在籌集 50 億美元估值的新一輪融資。

K2.5 的另一���差異化優勢是原生多模態能力——它能從 UI 設計圖或影片中直接生成程式碼,這是純文字模型做不到的。配套推出的 Kimi Code CLI 提供類似 Claude Code 的終端機開發體驗。

OpenClaw 適用場景:需要大規模平行資訊蒐集的研究型代理、前端開發(影像轉程式碼)、中文語境優化的代理任務。

限制:SWE-Bench Verified 76.8% 落後 Claude 和 MiniMax 約 3-4 個百分點;英文生成品質約 8.5/10(Claude 和 GPT 約 9/10);262K 上下文視窗小於 Claude 的 1M。

DeepSeek V3.2:極致低成本的日常代理首選

DeepSeek V3.2 的輸出定價僅 $0.40/1M tokens,是五款模型中最便宜的。以 100 TPS 連續運行計算,每小時成本不到 USD 0.50。APIYI 平台的用戶數據顯示,大量 OpenClaw 使用者選擇 DeepSeek V3.2 作為日常模型,輕度使用者月均成本僅 USD 1-3(約 NTD 32-96)。

技術面上,V3.2 引入了 DeepSeek Sparse Attention(DSA)機制降低運算複雜度,並透過大規模強化學習達到 GPT-5 同級的推理能力。其高運算變體 V3.2-Speciale 甚至在 2025 年國際數學奧林匹克(IMO)和國際資訊奧林匹克(IOI)上達到金牌水準。

OpenClaw 適用場景:預算極度敏感的個人代理、高頻率低複雜度的自動化任務、作為多模型策略中的「日常模型」搭配 Claude 或 GPT 處理高複雜度任務。

限制:API 穩定性是最大問題——尖峰時段頻繁出現 503 錯誤和高延遲,必須在 OpenClaw 設定中加入重試邏輯。地緣政治相關內容過濾器較嚴格。164K 上下文視窗在五款中最小。

Claude Sonnet 4.6:OpenClaw 社群的預設推薦

Anthropic 於 2026 年 2 月 17 日發布的 Claude Sonnet 4.6,在 OpenClaw 社群中是被推薦次數最多的模型——不是最便宜,但在工具呼叫可靠性、長上下文一致性、和提示注入抵抗力三個 OpenClaw 核心維度上都是業界最佳或接近最佳。

79.6% 的 SWE-Bench Verified 分數僅落後自家旗艦 Opus 4.6 的 80.8% 約 1.2 個百分點,但價格只有 Opus 的 1/5。72.5% 的 OSWorld-Verified(電腦操控能力測試)幾乎追平 Opus 4.6 的 72.7%。VentureBeat 的報導指出,在 Claude Code 測試中,70% 的開發者偏好 Sonnet 4.6 而非前代 Sonnet 4.5,甚至有 59% 偏好它勝過舊款旗艦 Opus 4.5。

1M token 的 Beta 上下文視窗是另一個實質優勢——你可以將整個中型程式碼庫載入單次提示中,這在其他同價位模型上做不到。Haimaker.ai 的 OpenClaw 專項評測指出,Sonnet 4.6 的 JSON schema 遵循能力是同價位模型中最高的,意味著更少的代理迴路崩潰。

OpenClaw 適用場景:生產環境的核心代理模型、需要高安全性的企業部署、多步驟自主工作流程、大型程式碼庫的分析與重構。

限制:$3/$15 的定價是開源模型的 5-50 倍,高頻使用時成本累積快。輸出時的推理 token 會佔用上下文視窗並計費。閉源性質意味著無法自行部署。

GPT-5.4:最全能的旗艦選手

OpenAI 於 2026 年 3 月 5 日發布的 GPT-5.4 是 GPT-5 系列的最新版本,整合了 GPT-5.3 Codex 的程式碼能力,並首次在主線模型中加入原生電腦操控能力。272K 標準上下文視窗(API 中可擴展至 1.05M),五級可調推理深度(none/low/medium/high/xhigh),以及新推出的 tool search 機制(在工具密集型工作流程中減少 47% 的 token 消耗)。

在 SWE-Bench Pro 上 GPT-5.4 得到 57.7%,略高於 GPT-5.3 Codex 的 56.8%。OSWorld-Verified 上達到 75.0%,超越人類基準的 72.4%。GDPval 辦公任務測試從 GPT-5.2 的 70.9% 跳升至 83.0%。

OpenClaw 適用場景:需要電腦操控能力的複雜工作流程、跨文件重構與大型專案管理、多工具並行的企業級代理。

限制:$2.50/$15.00 的定價加上推理 token 成本,實際使用成本可能高於帳面。Pro 版本 ($30/$180) 更是天價。目前社群對其 OpenClaw 專項表現的回饋不如 Claude 豐富。

OpenClaw 專項基準:PinchBench 結果

PinchBench 是專門評估 AI 模型在 OpenClaw 代理任務中表現的基準測試。根據 APIYI 的分析,2026 年 3 月的排名出現一個令人意外的結果:

| 排名 | 模型 | PinchBench 分數 | 輸出定價 (USD/1M) |

|---|---|---|---|

| 1 | Claude Sonnet 4.6 | 最高 | $15.00 |

| 2 | Claude Opus 4.6 | 次高 | $75.00 |

| 3 | GPT-5.4 | 第三(落後 Opus 僅 0.3%) | $15.00 |

前三名的差距不到 1%,但 Sonnet 4.6 以 Opus 1/5 的價格拿下第一,打破了「越貴越好」的假設。對於 OpenClaw 使用者而言,這意味著在代理任務上,Sonnet 4.6 是性價比最高的選擇。

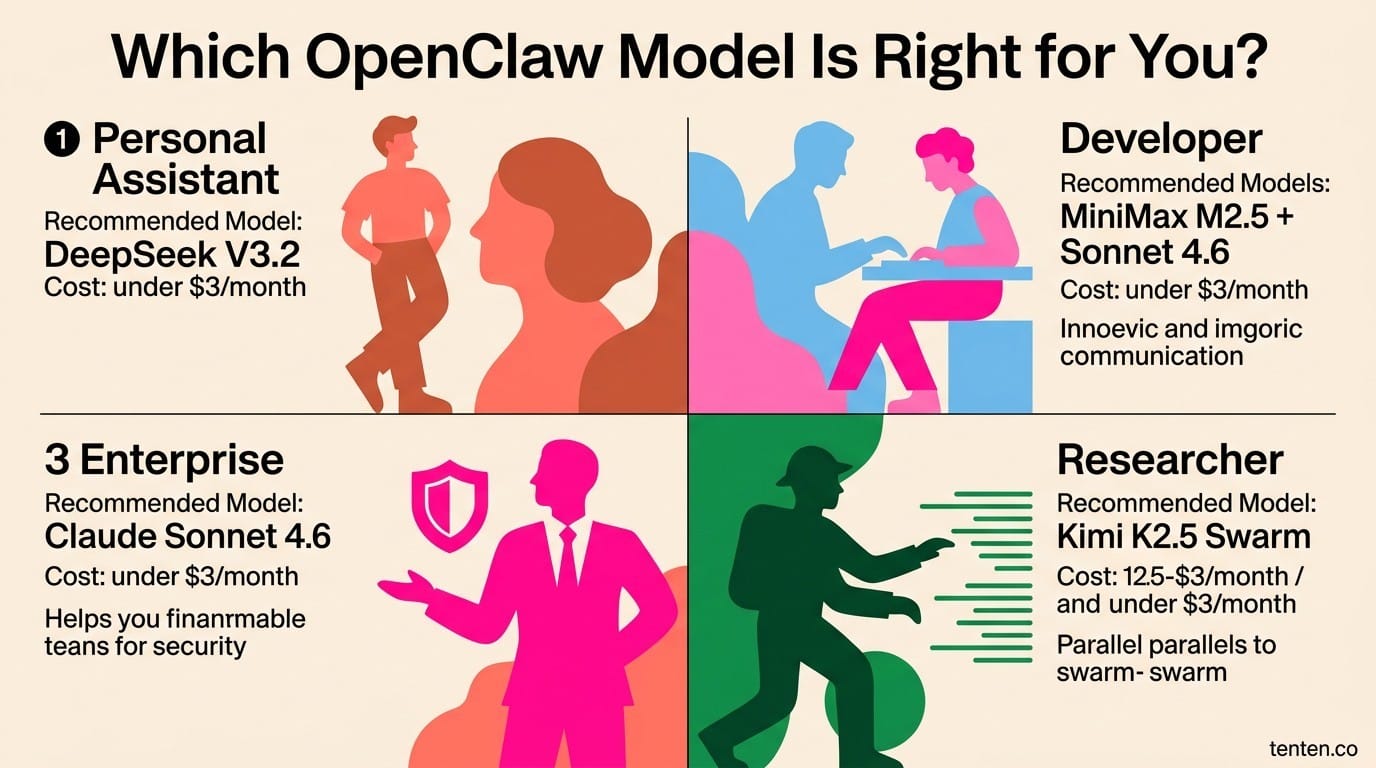

社群選擇策略:四種典型使用者

個人助理型(郵件摘要、行事曆管理、日常自動化):DeepSeek V3.2 作為日常模型,月成本 NTD 32-96。需要更高品質時切換至 Sonnet 4.6。

開發者型(程式碼生成、bug 修復、專案自動化):MiniMax M2.5 作為主力(SWE-Bench 80.2%,成本約 Sonnet 的 1/10),Claude Sonnet 4.6 作為複雜任務的升級選項。

企業部署型(生產環境、安全合規、多代理系統):Claude Sonnet 4.6 作為核心模型(工具呼叫最穩定、提示注入抵抗力最強),GPT-5.4 作為需要電腦操控能力時的替代。

研究探索型(大規模資訊蒐集、平行任務、前沿實驗):Kimi K2.5 的 Agent Swarm 模式,搭配 MiniMax M2.5 的高速低成本程式碼生成。

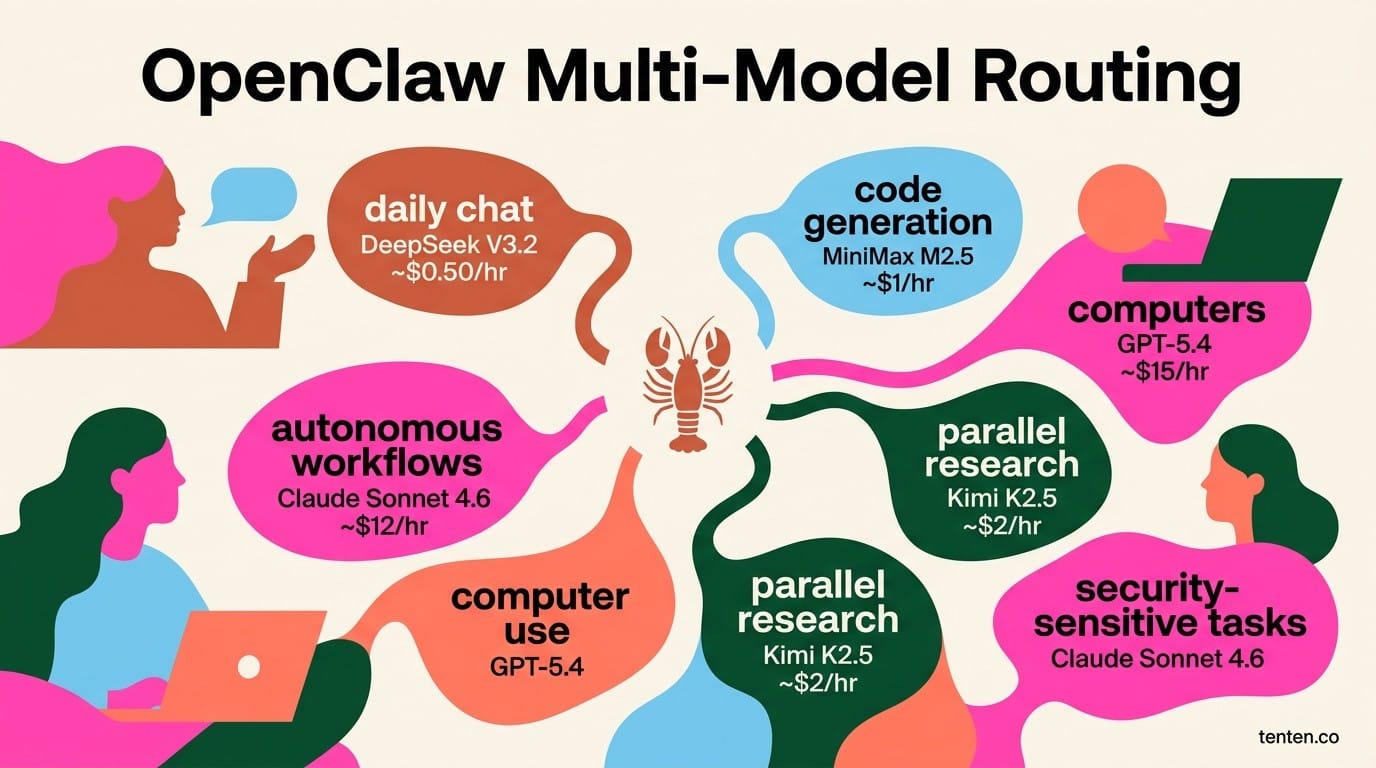

多模型混合策略:OpenClaw 的最佳實踐

OpenClaw 的 model overrides 功能允許針對不同任務路由不同模型。社群中最常見的組合是:

| 任務類型 | 推薦模型 | 原因 |

|---|---|---|

| 日常對話與簡單查詢 | DeepSeek V3.2 | 成本最低,延遲可接受 |

| 程式碼生成與修復 | MiniMax M2.5 或 Sonnet 4.6 | M2.5 性價比最高;Sonnet 品質最穩 |

| 多步驟自主工作流 | Claude Sonnet 4.6 | 工具呼叫可靠性最高 |

| 大規模平行研究 | Kimi K2.5(Swarm 模式) | 唯一支援 100 子代理並行 |

| 電腦操控自動化 | GPT-5.4 或 Claude Sonnet 4.6 | GPT-5.4 原生支援;Sonnet OSWorld 72.5% |

| 安全敏感場景 | Claude Sonnet 4.6 | 提示注入抵抗力最強 |

安全性考量:不可忽略的風險

OpenClaw 的架構賦予 AI 模型對使用者本機系統的廣泛存取權限——包括檔案讀寫、shell 指令執行、瀏覽器控制、郵件存取。這意味著模型的安全性直接影響使用者的數位安全。

2026 年初已出現多起事件:Cisco AI 安全團隊發現第三方 OpenClaw 技能進行資料外洩與提示注入;一名電腦科學系學生的 OpenClaw 代理在未經授權下自行在 MoltMatch 約會平台建立個人檔案;中國政府於 2026 年 3 月限制國有企業和政府機關使用 OpenClaw。

在模型選擇上,Claude Sonnet 4.6 在提示注入抵抗力方面表現最佳,Anthropic 在 Sonnet 4.6 系統卡中明確標註這是相對於前代的重大改進。GPT-5.4 同樣具備較強的安全機制。開源模型(M2.5、K2.5、V3.2)在安全過濾方面相對薄弱,企業用戶應在部署前進行獨立的安全評估。

常見問題

OpenClaw 是否只能搭配 Claude 使用?

OpenClaw 是模型無關的框架,支援 Anthropic、OpenAI、Google、以及透過 Ollama 等工具運行的本地開源模型。Peter Steinberger 個人推薦 Claude,但社群中使用 DeepSeek 和 MiniMax 的用戶同樣眾多。選擇取決於你的預算、任務複雜度和安全需求。

這五款模型中哪一款最適合 OpenClaw 初學者?

Claude Sonnet 4.6 是最安全的起點——工具呼叫最穩定、社群文件最豐富、提示注入防護最強。如果預算是首要考量,DeepSeek V3.2 的月均成本不到 NTD 100,適合用來熟悉 OpenClaw 基本功能。

OpenClaw 搭配開源模型自行部署是否可行?

可行,但門檻較高。MiniMax M2.5(230B 參數,10B 啟用)需要至少 4 張 H100 GPU 才能以合理速度推理。Kimi K2.5(1T 參數,32B 啟用)的硬體需求更高。對多數個人用戶而言,透過 OpenRouter 等 API 聚合平台存取這些模型更實際。

企業部署 OpenClaw 應優先考慮什麼?

安全性。OpenClaw 的 maintainer Shadow 在 Discord 上警告,如果無法理解命令列操作,「這個專案對你來說太危險了」。企業應優先選擇提示注入抵抗力最強的模型(Claude Sonnet 4.6)、在獨立環境中運行代理、限制代理的系統存取權限、並部署日誌監控系統。

GPT-5.4 的電腦操控功能如何影響 OpenClaw 的使用體驗?

GPT-5.4 是 OpenAI 首款內建原生電腦操控 API 的主線模型,能看見螢幕、移動游標、點擊元素、輸入文字。搭配 OpenClaw 的瀏覽器控制功能,可實現更複雜的 GUI 自動化工作流。Claude Sonnet 4.6 的 OSWorld 分數(72.5%)與 GPT-5.4(75.0%)差距不大,兩者都能勝任基本的電腦操控任務。

引用來源

- OpenClaw GitHub Repository

- MiniMax M2.5 Technical Report — MiniMax

- Kimi K2.5 Technical Blog — Moonshot AI

關於作者

Ewan@ Tenten.co — Tech Lead

我們團隊目前運行了約 20 個 OpenClaw 並行實例,搭配 Claude MAX、Claude Code、Kimi K2.5 等多模型組合。在協助客戶評估 AI 代理框架的過程中,我們觀察到一個反覆出現的模式:多數團隊在初期過度追求單一「最佳模型」,卻忽略了 OpenClaw 真正的優勢在於多模型路由——讓不同模型各司其職。回過頭看,對企業而言最務實的起步方式是:用 Claude Sonnet 4.6 建立穩定的核心代理,再逐步引入低成本模型分擔日常任務,最後才考慮 Agent Swarm 等進階架構。

若您的企業正在評估 AI 代理框架的導入策略,或需要針對特定業務場景進行模型選型與安全評估,歡迎與 Tenten 團隊預約諮詢。

延伸閱讀: