隨著 OpenAI 的競爭加劇,Google推出了最強大的人工智慧模型,應對 OpenAI 的 GPT-4o 的挑戰

台灣時間 5 月 15 日凌晨 1 點。而當大會開幕時間臨近,本應是討論度最高的時候,「宿敵」OpenAI 卻半路殺出,搶先一天,僅耗時 27 分鐘就發布了顛覆性巨作 GPT-4o,啟動了新一輪 AI 爭霸。

正如Nvidia科學家 Jim Fan 在評價 GPT-4o 時所言,在 Google I/O 大會之前,OpenAI 發布 GPT-4o 是爭取更多時間的明智之舉。

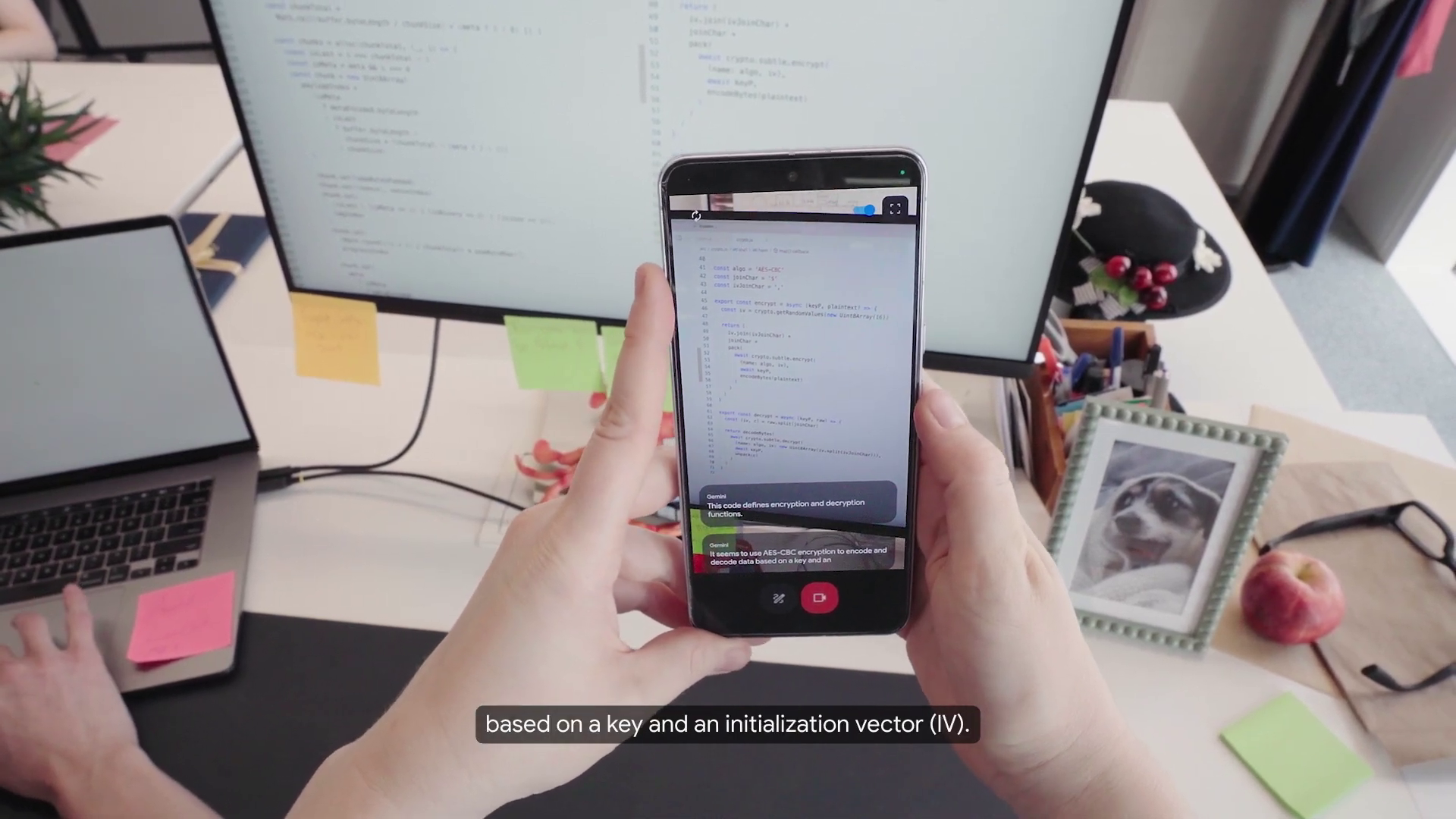

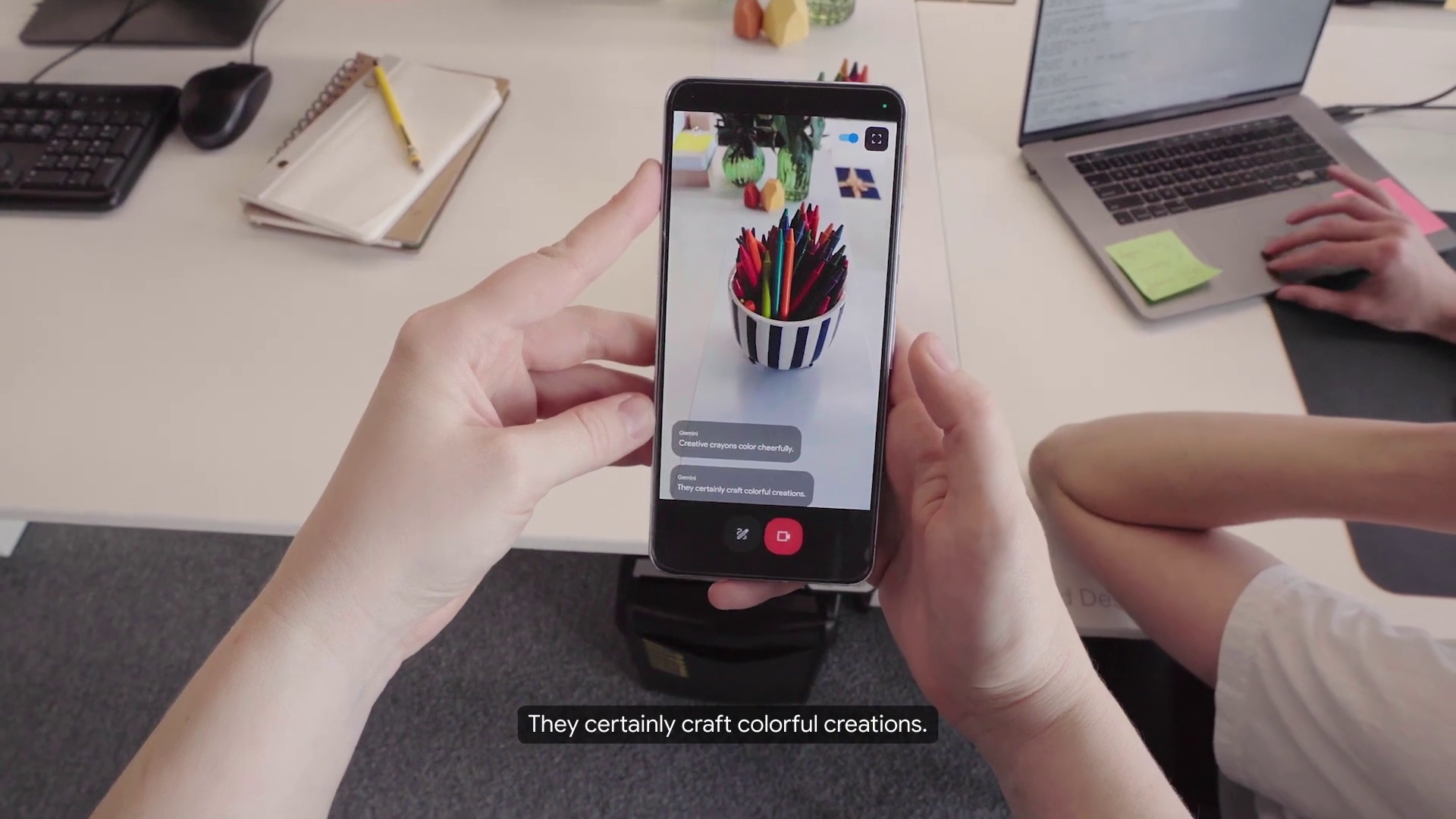

拋開雙方在公關策略上的博弈不談,OpenAI 的突然發力或許也預示著,Google的 Gemni 也同樣來到了語音交互段位。在 Google I/O 開幕前,Google官方賬號發布了一段與 Gemini 語音交互的影片,在展示 demo 中,Gemini 不僅能夠通過手機攝像頭即時識別場景,還能夠進行流暢的語音交互。

Google發布這段 demo 的用意不言而喻,但評論中也不乏質疑其影片造假的聲音,畢竟早有「前科」。而在今天的主題演講中,CEO - Sundar Pichai 也並未帶來像 GPT-4o 前天發佈「語音交互」功能的實測,而是再度通過 demo 展示了與 GPT-4o 類似的能力。

具體而言,Google CEO Sundar Pichai 及一眾高管在將近 2 小時的主題演講中一口氣介紹了:

- Gemini 1.5 Pro 的更新

- Gemini 2.5 Flash

- Project Astra

- AI Overviews

- Veo 和 Imagen 3

- 與 Nvidia 合作下一代的 AI 晶片架構

- Deepmind

- AlphaFold 3

- ....

Google I/0 2024 開場影片

Google I/O 2024 Keynote

Gemini 1.5 Pro:拓展至 200 萬 tokens

經歷了昨天凌晨的 GPT-4o 發布,大家已經基本從「大模型即時通話」的震驚中走出來了,這也意味著,OpenAI 成功將行業競爭拉至新的制高點,所以,Google也必須跟上。而作為自家「最大、最強」的 AI 模型,Gemini 必須為公司搭建好天梯。

今年 2 月,Google宣布推出了 Gemini 1.5,其中的 Gemini 1.5 Pro 最高可支持 100 萬 token 超長上下文,在 token 數量上一度拉開了與同期大模型之間的差距。今天 ,Google再次突破上下文窗口限制,Pichai 宣布將 Gemini 1.5 Pro 的上下文窗口擴展到 200 萬 tokens - 並向開發人員提供私人預覽版 (private preview)。

同時,Pichai 宣布將向全球所有開發人員提供改進版的 Gemini 1.5 Pro,其 100 萬 token 上下文版本現在可以直接在 Gemini Advanced 中供消費者使用,該版本可用於 35 種語言。

此外,Pichai 還表示 Gemini 1.5 Pro 在過去幾個月中通過改進演算法得到了增強,在程式碼生成、邏輯推理和規劃、多輪對話以及音頻和圖像理解方面都有了很大改進。在 Gemini API 和 AI Studio 中,除了圖像和影片,Gemini 1.5 Pro 還能對音頻進行推理,並通過一種名為系統指令的功能進行引導。

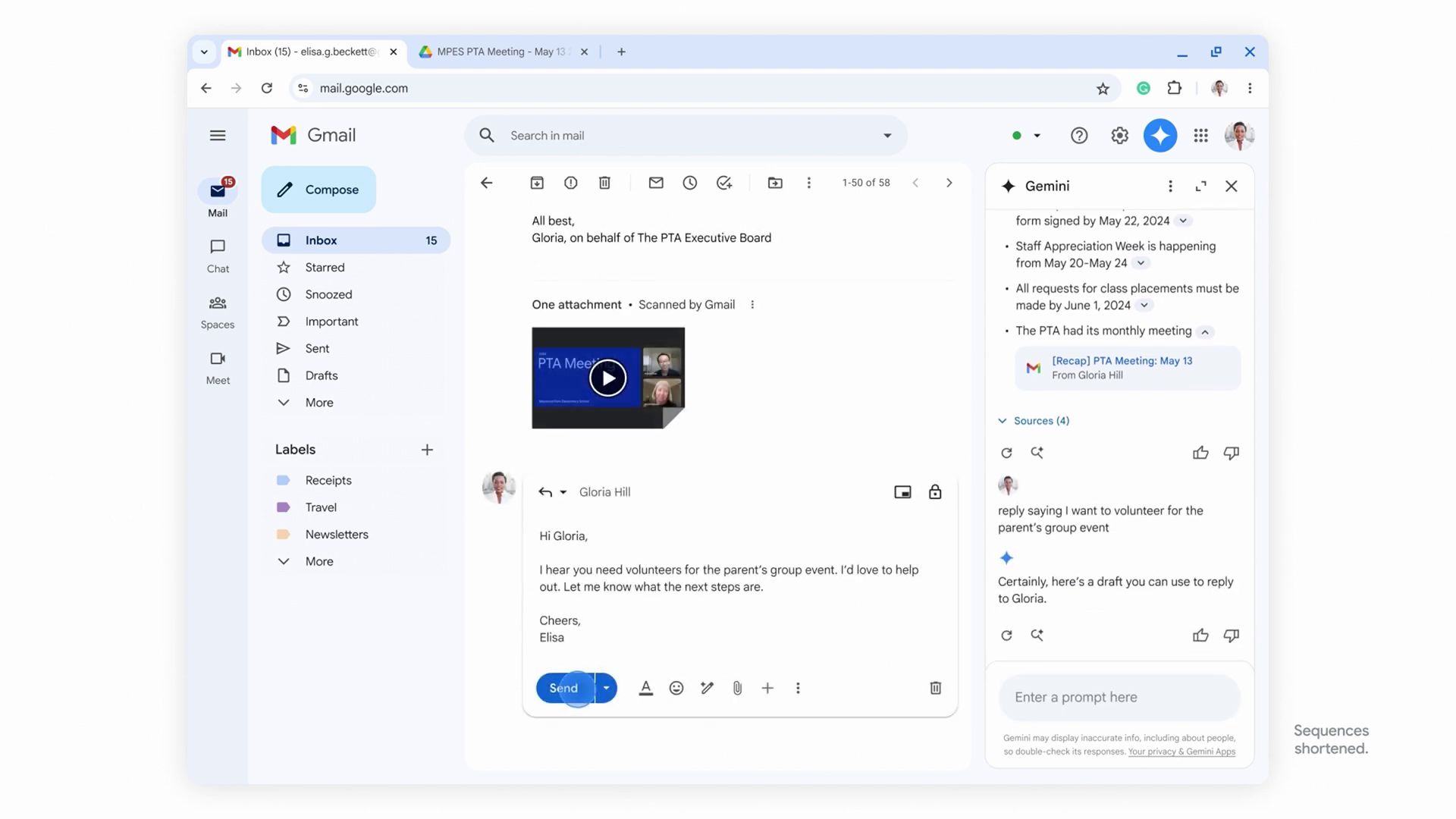

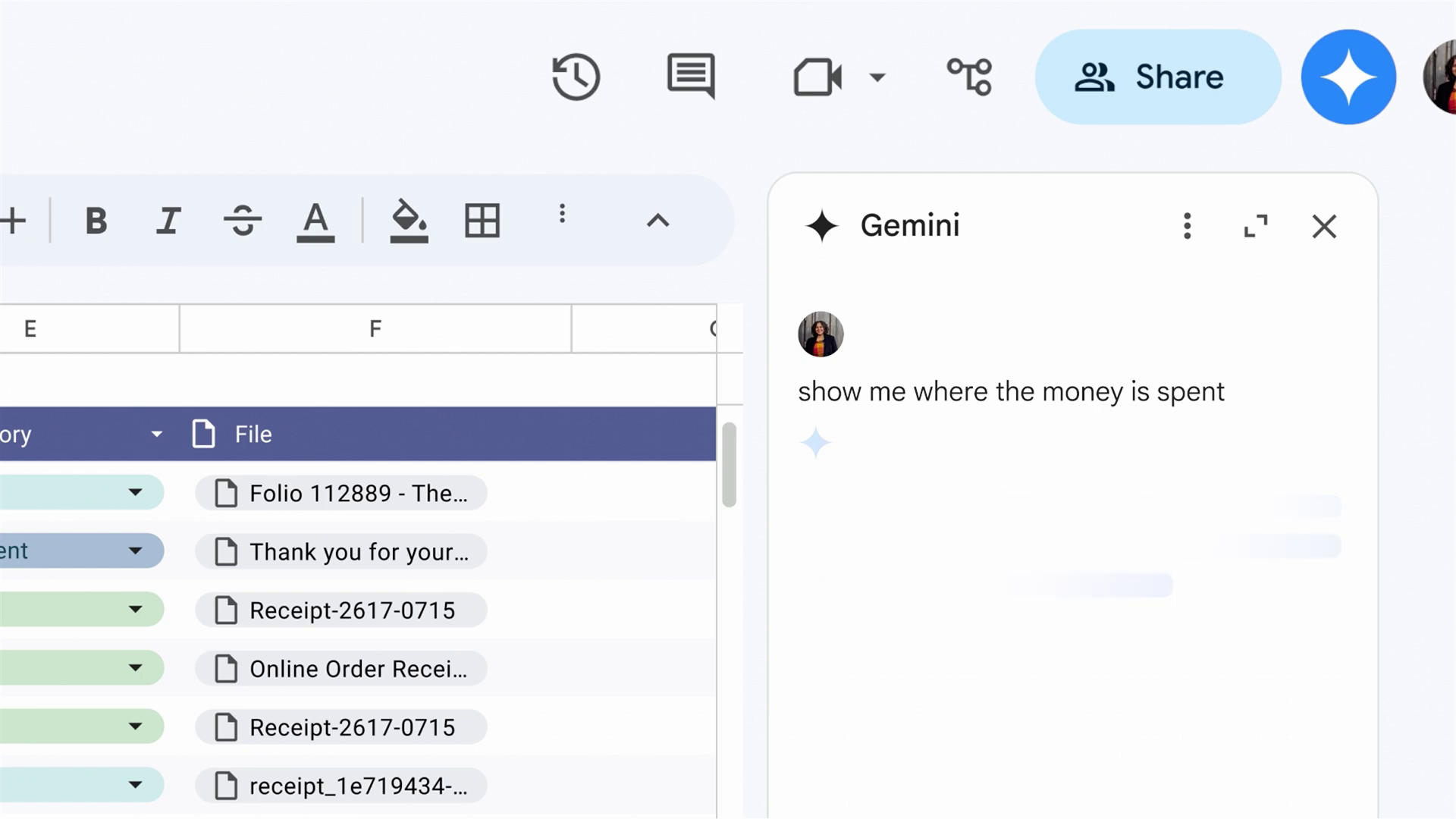

隨後,Pichai 還介紹了 Gemini 在 Google Workspace 中的更新,包括 Gmail、Docs、Drive、Slides 和 Sheets 中的 Gemini 將升級至 Gemini 1.5 Pro,Gmail 移動端 APP 推出了新功能(總結郵件、上下文智能回復、Gmail Q&A),「Help me write」支持多語音寫作。

Gemini 1.5 Flash:100 萬 tokens 超長上下文、多模態

就當大家以為 Gemini 1.5 的更新「僅此而已」時,DeepMind CEO Demis Hassabis 緩步登場,帶來了今天的第一個驚喜——Gemini 1.5 Flash。

具體而言,輕量級模型 Gemini 1.5 Flash 是 Gemini 1.5 Pro 的精煉版本,針對大容量、高頻率的大規模任務進行了優化,服務成本效益更高,並具有突破性的長上下文窗口。同時,Gemini 1.5 Flash 與 Gemini 1.5 Pro 一樣是多模態的,這意味著其可以分析音頻、影片和圖像以及文本。

Demis Hassabis 表示,Gemini 1.5 Flash 擅長匯總、聊天應用、圖像和影片字幕、從長文檔和表格中提取數據等任務。這是因為 Gemini 1.5 Pro 通過蒸餾 (distillation) 對其進行了訓練,將較大模型中最基本的知識和技能轉移到了更小、更高效的模型中。

除此之外,Demis Hassabis 還介紹了關於 Gemma 的更新,Google宣布推出新一代開放式人工智慧創新模型 Gemma 2,其採用全新架構,旨在實現突破性的性能和效率,並將在 6 月正式發布時推出新尺寸。

Project Astra:即時、多模態 AI Agent

在 Google I/O 開幕前的一眾爆料與猜測中,AI Assistant Pixie 呼聲極高。有媒體稱,預計Google將推出一款由 Gemini 支持的全新 Pixel AI Assistant,名為 Pixie,其可能具備多模態功能,可以通過用戶設備上的資訊,如地圖或 Gmail,提供更加個性化的服務。

然而 Pixie 並未如預期般露面,取而代之的是具備多模態理解與即時對話能力的 Project Astra。

Demis Hassabis 表示,在開發能夠理解多模態資訊的 AI 系統方面,Google已經取得了喜人的進展,但如何將響應時間縮短到可進行即時對話的程度卻頗具挑戰。在過去幾年中,團隊一直在努力改進模型的感知、推理和對話方式,使交互的節奏和質量感覺更加自然。

Project Astra - 這是由人工智慧驅動的通用助理的早期版本,Google DeepMind 執行長 Demis Hassabis 表示,這是Google版本的人工智慧代理,「可以在日常生活中提供幫助」。

在 Google 稱是一次拍攝的影片中,一名 Astra 用戶在谷歌倫敦辦公室周圍走動,舉起手機,將攝像頭對準各種物體——揚聲器、白板上的一些代碼、窗外——然後與應用程序就其外觀進行自然對話。在影片中最令人印象深刻的時刻之一,它正確地告訴用戶她之前把眼鏡放在哪裡,而用戶甚至沒有拿起眼鏡。

目前,團隊基於 Gemini 開發了 Agent 原型 (prototype agents),通過對影片幀進行連續編碼,將影片和語音輸入結合到事件時間軸中,並緩存這些資訊以便高效調用,從而加快資訊處理速度。

同時,Google利用其語音模型,增強了 Agent 的聲音,使其具有更廣泛的語調,從而在識別使用環境后,在對話中做出快速反應。

這不禁令人聯想到 OpenAI 昨日凌晨展示的新版 ChatGPT,同樣是即時對話、可根據情境或用戶要求轉換語調。不同於Google的影片Demo,ChatGPT 在直播現場進行了實測,並回答了網上呼聲較高的多個問題。如今,基於 GPT-4o 的 ChatGPT 已經免費開放給所有用戶,但音頻影片功能卻出於隱私考慮仍未上線。

影片結尾有一個轉折——當用戶找到並戴上丟失的眼鏡時,我們了解到他們有一個機載攝像系統,並且能夠使用 Project Astra 與用戶無縫地進行對話,這可能表明谷歌可能正在努力Meta的雷朋智慧眼鏡的競爭對手。

Google Photos - Ask Photos

在搜尋特定圖像或影片時,Google照片已經很智能,但透過人工智慧,Google 正在將事情提升到一個新的水平。如果您是美國的Google One 訂閱者,當該功能在未來幾個月推出時,您將能夠向Google Photos 提出一個複雜的問題,例如「向我展示我訪問過的每個國家公園的最佳照片」。Google照片將使用GPS資訊以及它自己的「最佳」判斷來為您提供選項。您還可以要求谷歌照片生成標題以將照片發佈到社交媒體。

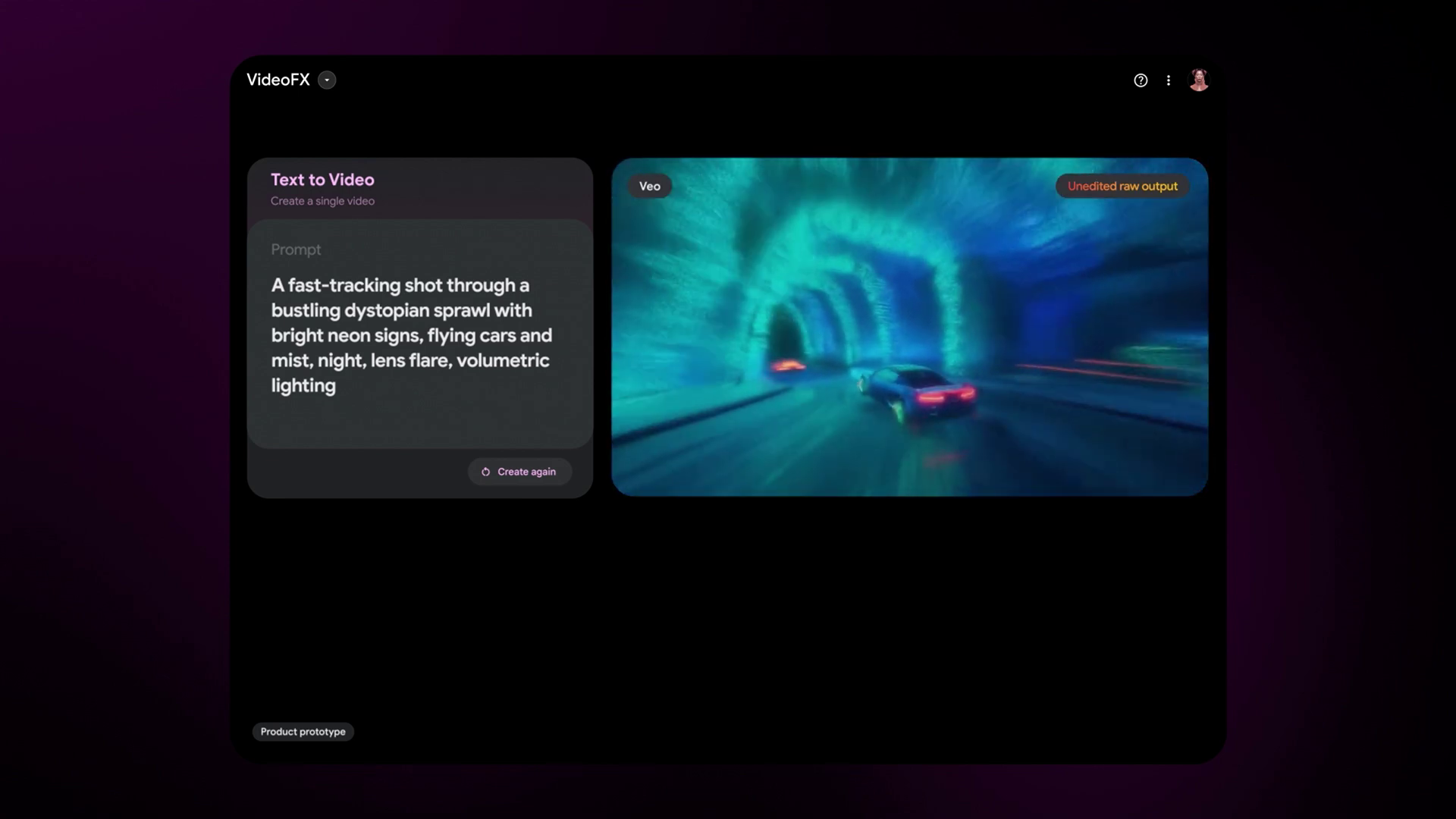

Veo 和 Imagen 3:影片+圖像雙管齊下

Google還推出了最新的影片生成模型 Veo 和高質量的文本到圖像模型 Imagen 3。

其中,Veo 是Google最強大的影片生成模型,應該是對標 Sora 而來。而 Imagen 3 應該是 Midjourney 或 Runway 等其他 AI 繪圖的產品。

Veo 可生成各種電影和視覺風格的 1080p 解析度影片,影片時長可超過一分鐘。Google表示,憑借對自然語言和視覺語義的深入理解,其所生成的影片可完美呈現用戶的創意構想,準確捕捉提示語的語氣並呈現較長提示語中的細節。

同時,Veo 創建的鏡頭是一致的、連貫的,因此人、動物和物體在整個拍攝過程中的移動都顯得更加真實。

在技術層面,Veo 基Google多年的生成影片模型經驗,融合了 GQN、DVD-GAN、Imagen-Video、Phenaki、WALT、VideoPoet 和 Lumiere,將架構、縮放規律等技術相結合,以提高質量和輸出解析度。

同樣地,Imagen 3 也是Google最高質量的文本到圖像模型,能夠更好地理解自然語言和 Prompt 背後的意圖,並將較長提示中的小細節融入其中,這種高級理解能力也有助於該模型掌握各種風格。

AI Overviews:Google搜索的大模型時代

25 年前,為了幫助人們更好地理解網上繁雜的資訊,Google搜索由此誕生,人們可以在該引擎上檢索各類問題的答案。現如今,Gemini 的出現將Google搜索推到了一個新的高度,重新定義了人們獲取知識與解答疑惑的方式。

對此,Google在會議中表示:「無論您心中有什麼,無論您需要完成什麼,只要提問,Google就會為您搜索。」

Google擁有超過萬億關於人、地點和事物的即時資訊,搭配其備受信賴質量系統,可以為用戶提供網路上最好的內容。而 Gemini 的加入,則進一步解鎖了搜索中的新 Agent 能力,拓展了Google搜索更多的可能性。

其中,最讓人關注的莫過於 AI Overviews 功能的推出。「有了 AI Overviews,用戶提出問題后無需自己拼湊所有資訊,Google搜索將會為你列出資訊的概覽,包括多種觀點和連結進行更深入的探索。」

Google搜索業務副總裁 Liz Reid 在會議中講道,「AI Overviews 將從今天開始在美國向所有人推出,預計到今年年底,AI Overviews 將為全球超過 10 億Google搜索用戶提供服務。」

「事實上,這隻是第一步,我們正在讓 AI Overviews 解鎖更複雜的問題,為了使其成為可能,我們在 Google 搜索中引入了多步驟推理 (Multi-step reasoning)。」

簡單來說,多步驟推理就是將用戶的總問題分解成各個部分,並確定需要按什麼順序解決哪些問題,然後,Google 搜索會基於現實的即時資訊和排名等,使用最優質的資訊來進行問題的推理。

例如,當用戶詢問地點時,Google 搜索會根據現實世界的資訊,包括超過 2.5 億個地點,以及它們的評分、評論、營業時間等來進行問題的回復,這些資訊用戶需要經過幾分鐘甚至更久的時間進行研究,但 Google 搜索幾秒鐘就能完成。

除了提供基本的資訊檢索,Google 搜索也能執行高級推理和富有邏輯的規劃任務,幫助用戶完成餐飲、旅行、派對、約會、鍛煉等活動的規劃,讓用戶的生活更輕鬆。

最後,對於那些用文本或圖片也無法準確表達的問題,Google也給出了解決方案——即將推出影片提問功能,這意味著未來 Google 搜索的介面將會變得更加多元化。

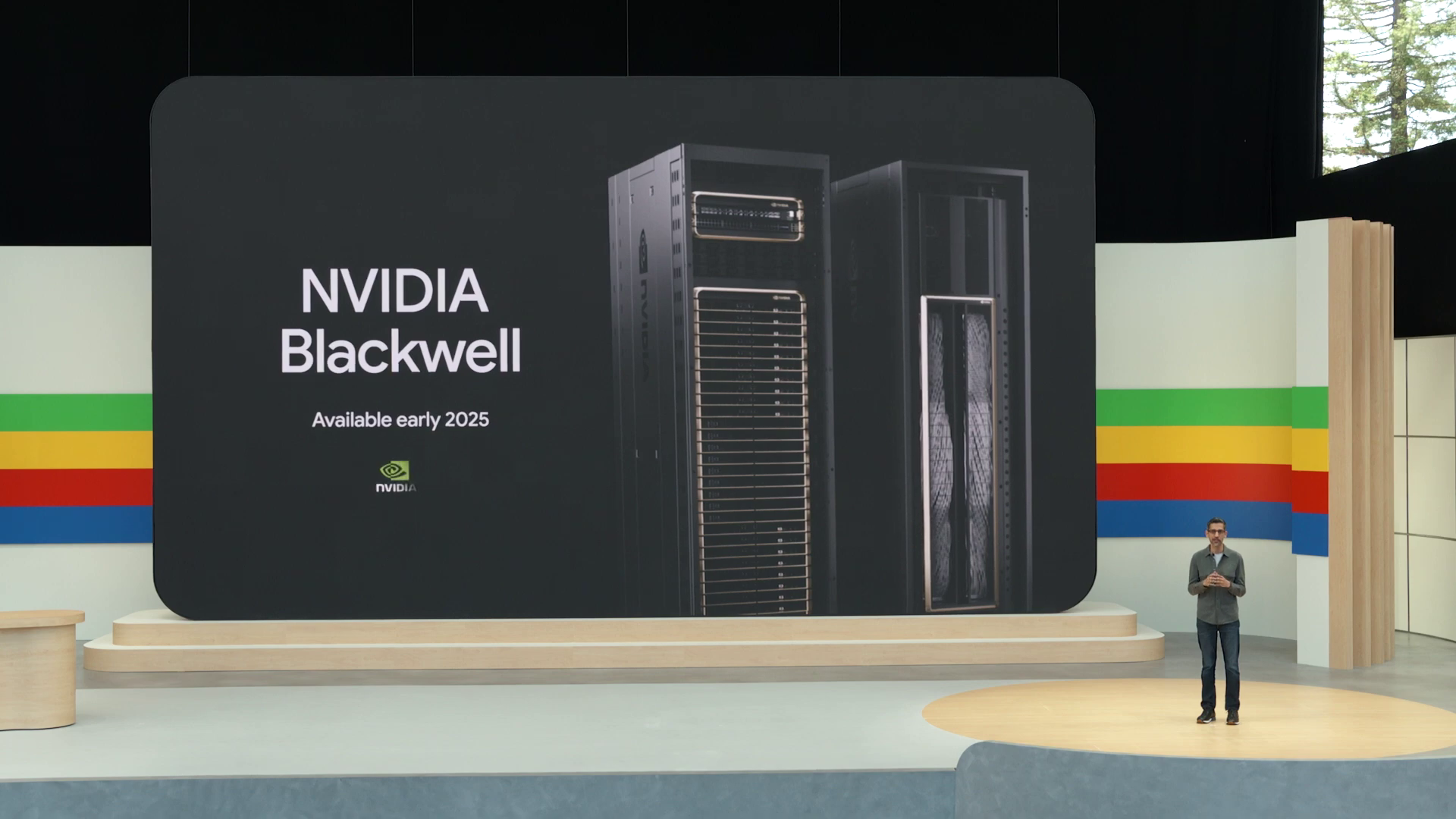

Trillium:每個晶元的計算性能提高 4.7 倍

據路透社報道,在人工智慧數據中心晶元市場上,Nvidia佔據了大約 80% 的市場份額,剩下的 20% 絕大部分是Google各種版本的 TPU。不過Google本身並不銷售晶元,而是通過其雲計算平台出租晶元。

作為公司的重要業務,宣布新一代 TPU 似乎已經成為了 Google I/O 的傳統。今天,Pichai 發布了Google第六代 TPU Trillium,並稱這是公司迄今為止性能最好、效率最高的 TPU,比上一代 TPU v5e 在每個晶元的計算性能上都提高了 4.7 倍。同時還承諾將在 2024 年底向雲客戶提供 Trillium。

據 Tech Crunch 報道,在一定程度上,Google是通過擴大晶元的矩陣乘法單元 (MXU) 並提高整體時鐘速度來實現性能提升的。此外,Google還將 Trillium 晶元的記憶體帶寬提高了一倍。

此外,Pichai 還補充介紹了公司上個月發布的全新 Axion 處理器,這是Google首款基於 Arm 的定製 CPU,具有業界領先的性能和能效。隨後,Pichai 還宣布穀歌將與Nvidia達成合作,將在 2025 年推出與Nvidia合作的 Blackwell 晶片架構。

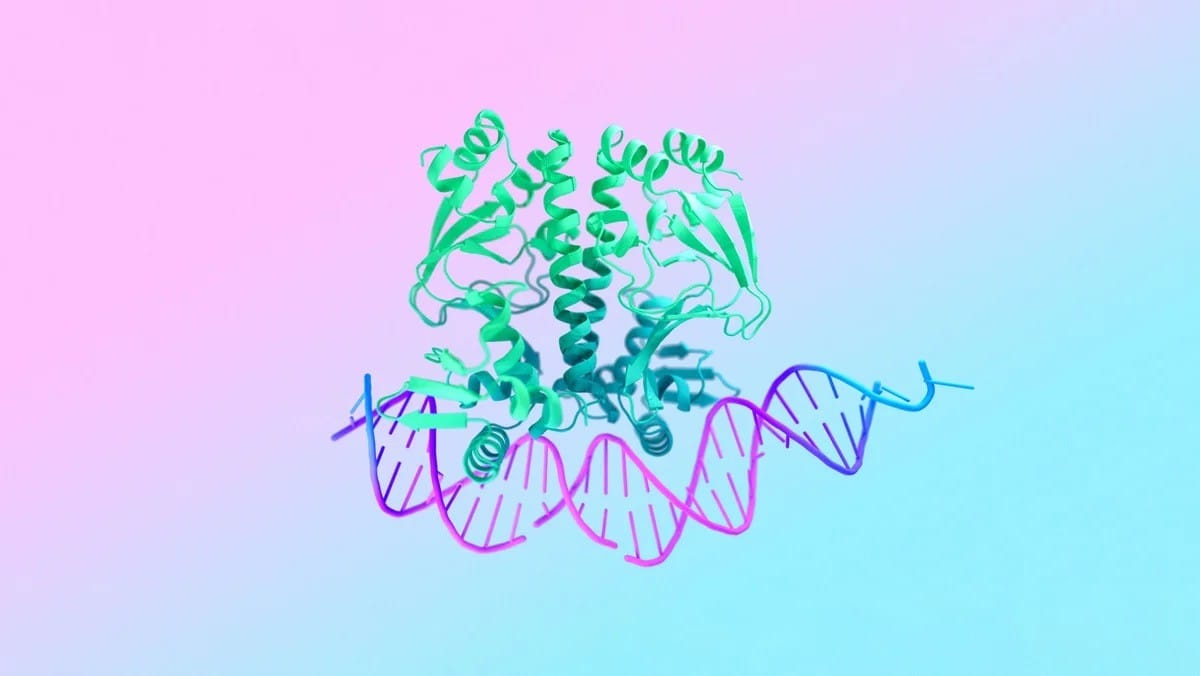

AI for Science:AlphaFold 3 或許將開放原始碼

DeepMind 創始人 Demis Hassabis 介紹道,「為了探究電腦能否像人一樣思考,建構通用人工智慧,我們創立了 DeepMind。」

回顧之前的成果,從將視覺和語言轉化為機器人行動的 RT-2、可以遵循自然語言指令在各種影片遊戲環境中執行任務的遊戲 AI 智能體 SIMA,到可以解決奧賽級別數學問題的 AIphaGeometry、甚至發現新材料的 GNoME。Demis Hassabis 表示:「我一直相信,如果我們能負責任地建構 AGI,它將會以難以置信的方式造福人類。」

此外,在會議中,Demis Hassabis 還重點強調了近期推出的 AlphaFold 3,該模型以前所未有的精確度成功預測了所有生命分子(蛋白質、DNA、RNA、配體等)的結構和相互作用,在模擬多種不同類型的分子相互作用方面取得了重大突破,這對精準確定藥物靶點等研發項目至關重要。

事實上,最初發布 AlphaFold 3 時,Google 沒有開放原始碼其完整程式碼的計劃,只是為該模型發布了一個支持非商業性研究的 AlphaFold Server 的公共介面,向全球科研人員敞開了大門。

然而,僅僅離發布不到一周的時間,Google DeepMind 研究副總裁突然宣布:「我們將在 6 個月內發布 AF3 模型(包括權重),供學術界使用!」Google 在 I/O 大會開始的前一天突然宣布這個開放原始碼計劃,無論是迫於 OpenAI 的壓力,還是為大會造勢預熱,AlphaFold 3 的開放原始碼都對生命健康領域的發展具有深遠的意義。

近期,Tenten 將對 Google AI for Science 的最新布局進行追蹤,感興趣的小夥伴可以訂閱電子報!

其他 AI 功能 - Google 搜尋的重大更新

Google 正在對搜尋的基本運作方式做出重大改變。

一年前 - Google 表示它相信人工智慧(AI)是搜尋的未來。這個未來現在已經到來:Google 向美國用戶推出“AI 概述”功能(以前稱為搜尋生成體驗,SGE),並將很快向全球用戶推出。此功能將在許多搜尋結果的頂部提供 AI 生成的摘要,標誌著 AI 改變搜尋的開始。

Google 新任命的搜尋主管利茲·里德(Liz Reid)表示:「我們看到生成式 AI 讓 Google 可以為您做更多的搜尋工作。」在 I/O 開發者大會上,Google 推出了幾個新功能,包括 AI 概述、Lens 中的影片搜尋功能,以及生成旅行或膳食計劃的工具。這些功能旨在簡化搜尋過程,使用戶能夠專注於最重要的部分。

這一搜尋的 AI 驅動轉型由 Google 的 Gemini AI 提供支持,該 AI 可總結網路內容並設計結果頁面。然而,並非所有搜尋都需要如此廣泛的 AI 集成,尤其是簡單的導航查詢。

Google Expands AI Overviews to All Search Users

Google 的目標是將其知識圖譜與 AI 結合,提供更全面和有用的搜尋結果,通過減少大量搜尋的需求並有效地提供相關信息來提升用戶體驗。

- 利用生成式人工智慧改進搜尋

- 使用 AI 幫助您購物

- 透過 AI 概述快速取得答案

但 Google 稱之為「人工智慧概覽」的一項重要新功能,該公司已經測試了一年,終於向數百萬人推出。Google AI 搜尋現在將預設在結果之上顯示人工智慧產生的答案,該公司表示,到今年年底,它將為全球超過 10 億用戶提供該功能。

- Google 正在重新設計其搜尋引擎——從頭到尾都是人工智慧 [The Verge]

- Google 如何利用生成式人工智慧來改善搜索 [Google Blog]

寫在最後

至此,連續兩日的 AI 狂歡落下帷幕。但 OpenAI 與Google的對壘不會停歇——GPT-5 的性能天花板在哪?Gemini 的超長上下文限制能否再有突破?OpenAI 的搜索引擎是否會衝擊Google的地位……

Nvidia科學家 Jim Fan 評價道,「Google正在做的一件事是正確的:他們終於在認真努力地將人工智慧整合到搜索框中。我感覺到了 Agent:規劃、即時瀏覽和多模態輸入,所有這些都來自登陸頁面。Google最強大的護城河是分銷 (distribution)。Gemini 不一定要成為最好的模型,也可以成為世界上最常用的模型。」

誠然,縱覽整場發布會,我們最大的感受是「在大模型時代,搜索或許依舊能夠成為Google最大的底氣」。

Google Gemini 1.5 Pro FAQ:

什麼是 Google Gemini 1.5 Pro?

Google Gemini 1.5 Pro 是 Google 推出的最新語言模型,旨在提升語言生成和理解能力,並提供更準確的回應。

Google Gemini 1.5 Pro 有哪些主要特點?

Google Gemini 1.5 Pro 具備更強大的語言生成能力、更快的回應速度和更高的準確性,並支持多語言。

如何使用 Google Gemini 1.5 Pro?

要使用 Google Gemini 1.5 Pro,您需要訪問 Google Cloud Platform,註冊並獲取 API 金鑰,然後將其集成到您的應用中。

Google Gemini 1.5 Pro 的應用場景有哪些?

Google Gemini 1.5 Pro 可應用於客服系統、內容生成、語音助手和機器翻譯等多個場景。

Google Gemini 1.5 Pro 的優勢是什麼?

Google Gemini 1.5 Pro 提供更高的準確性、更自然的語言生成和更廣泛的應用支持,能夠滿足不同業務需求。

Google Gemini 1.5 Pro API 的定價模式如何?

Google Gemini 1.5 Pro 的定價根據使用量和功能需求而定,具體價格可以在 Google Cloud Platform 上查看。

未來 Google Gemini 1.5 Pro 的發展方向是什麼?

未來,Google Gemini 1.5 Pro 將進一步提升其語言生成和理解能力,並拓展其應用範圍,以支持更多場景和需求。

更多關於 Google I/O 大會 2024 與 Gemini 1.5

- Google在 Google I/O 大會上發布輕量級 AI 模型 Gemini Flash 1.5

- Google I/O 2024 上宣布的所有內容包括 Gemini AI、Project Astra、Android 15 等

- Google推出下一代人工智慧模型 Gemini 1.5

- Gemini Pro - Google DeepMind

- Gemini 1.5 Pro 更新、1.5 Flash 首次亮相以及 2 款新 Gemma 型號

- 雙子座 - Google DeepMind

- 開發人員如何使用 Gemini 1.5 Pro 的 100 萬代幣上下文視窗 - YouTube

- Vertex AI 與 Gemini 1.5 Pro 和 Gemini 1.5 Flash | Google雲

- Google利用 Gemini Flash 加快 AI 速度 - The Verge

- We』re announcing new, powerful ways to get more done in your personal and professional life with Gemini for Google Workspace. | Google Workspace Blog

- Gemini 1.5 Pro 現已在 180 多個國家/地區發售;具有原生音訊理解、系統指令、JSON 模式等 - Google 開發者部落格

- Vertex AI I/O 公告:Gemini 與 Gemma 模型 | Google雲端部落格

- Gemini API 定價 |面向開發者的Google人工智慧 | Google開發者

- Google發表Gemini 1.5,可支援長達100萬個Token的脈絡 | iThome

- Gemini 1.5:我們的下一代模型,現已可在 Google AI Studio 中進行私人預覽 - Google 開發者部落格

- Gemini API 文件與參考 |面向開發者的Google人工智慧 | Google開發者

- 雙子座1.5 Pro |快速工程指南

更多關於 OpenAI 與 Google Gemini AI 的較量

- OpenAI 推出全新 GPT-4o ,更快更強大,且免費使用

- Google 搜尋變糟了? 研究揭露生成式 AI 的 SEO 氾濫

- ChatGPT 3.5 開放免註冊使用!引爆 AI 語言模型大戰

- 探索 GPT-4 Turbo:釋放先進人工智慧的潛力

想了解更多科技圈的創新與 AI?

如果你對我們的文章感興趣,不妨關注我們的 IG 或 Youtube頻道 ,訂閱電子報,或參考行銷小編專屬 GPT Prompt 懶人包 。